Теория адаптивного резонанса. Реализация

APT представляет собой нечто большее, чем философия, но намного менее конкретное, чем программа для компьютера. Поэтому возник широкий круг реализаций, сохраняющих идеи APT, но сильно отличающихся в деталях. Описываемая далее реализация может рассматриваться в качестве типовой, но необходимо иметь в виду, что другие успешные реализации имеют большие отличия от нее.

Функционирование сетей APT

Рассмотрим более детально пять фаз процесса функционирования APT: инициализацию, распознавание, сравнение, поиск и обучение.

Инициализация. Перед началом процесса обучения сети

все

весовые векторы  и

и  , а также параметр сходства

, а также параметр сходства  , должны

быть установлены в начальные значения.

, должны

быть установлены в начальные значения.

Веса векторов  все инициализируются в одинаковые малые

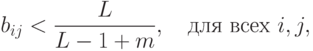

значения. Эти значения должны удовлетворять условию

все инициализируются в одинаковые малые

значения. Эти значения должны удовлетворять условию

где  — количество компонент входного вектора,

— количество компонент входного вектора,  — константа,

большая 1 (обычно

— константа,

большая 1 (обычно  ).

).

Эта величина является критической; если она слишком большая, сеть может распределить все нейроны распознающего слоя одному входному вектору.

Веса векторов  все инициализируются в единичные значения,

так

что

все инициализируются в единичные значения,

так

что

Эти значения также являются критическими; показано, что слишком маленькие веса приводят к отсутствию соответствия в слое сравнения и отсутствию обучения.

Параметр сходства  устанавливается в диапазоне от 0 до 1 в

зависимости от требуемой степени сходства между запомненным образом и

входным вектором. При высоких значениях

устанавливается в диапазоне от 0 до 1 в

зависимости от требуемой степени сходства между запомненным образом и

входным вектором. При высоких значениях  сеть относит к одному

классу только очень слабо отличающиеся образы. С другой стороны, малое

значение

сеть относит к одному

классу только очень слабо отличающиеся образы. С другой стороны, малое

значение  заставляет сеть группировать образы, которые имеют

слабое

сходство между собой. Для выработки точной классификации полезна

возможность изменять коэффициент сходства на протяжении процесса

обучения, обеспечивая только грубую классификацию в начале процесса

обучения и затем постепенно увеличивая коэффициент сходства.

заставляет сеть группировать образы, которые имеют

слабое

сходство между собой. Для выработки точной классификации полезна

возможность изменять коэффициент сходства на протяжении процесса

обучения, обеспечивая только грубую классификацию в начале процесса

обучения и затем постепенно увеличивая коэффициент сходства.

Распознавание. Появление на входе

сети входного вектора  инициализирует фазу распознавания. Так как вначале выходной вектор слоя

распознавания отсутствует, сигнал

инициализирует фазу распознавания. Так как вначале выходной вектор слоя

распознавания отсутствует, сигнал  устанавливается в 1 функцией

ИЛИ

вектора

устанавливается в 1 функцией

ИЛИ

вектора  , обеспечивая все нейроны слоя сравнения одним из двух

входов,

необходимых для их возбуждения (как требует правило двух третей). В

результате любая компонента вектора

, обеспечивая все нейроны слоя сравнения одним из двух

входов,

необходимых для их возбуждения (как требует правило двух третей). В

результате любая компонента вектора  , равная единице,

обеспечивает

второй единичный вход, заставляя соответствующий нейрон слоя сравнения

возбуждаться и устанавливая его выход в единицу. Таким образом, в этот

момент времени вектор

, равная единице,

обеспечивает

второй единичный вход, заставляя соответствующий нейрон слоя сравнения

возбуждаться и устанавливая его выход в единицу. Таким образом, в этот

момент времени вектор  идентичен вектору

идентичен вектору

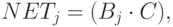

Как обсуждалось ранее, распознавание реализуется вычислением свертки для каждого нейрона слоя распознавания, определяемой следующим выражением:

где  — весовой вектор, соответствующий нейрону

— весовой вектор, соответствующий нейрону  в слое

распознавания,

в слое

распознавания,  — выходной вектор нейронов слоя сравнения (в

этот

момент

— выходной вектор нейронов слоя сравнения (в

этот

момент  равно

равно  ),

),  —

возбуждение нейрона

—

возбуждение нейрона  в слое

распознавания.

в слое

распознавания.

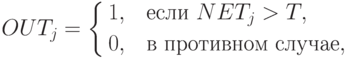

является пороговой функцией, определяемой следующим образом:

является пороговой функцией, определяемой следующим образом:

где  представляет собой порог.

представляет собой порог.