|

Не удается заказать доставку сертификата ни в pdf - ни в бумажном виде, сайт выдает окно с сообщением "Ошибка" и сразу его закрывает. |

Эволюция ИИ в процессе решения практических задач

Естественно ожидать, что процесс наращивания количественных показателей, отмеченный на рис. 2.32, должен был привести к появлению качественных возможностей нейросетевых моделей. И такой переход количества в качество был отмечен - по сути, так можно трактовать появление нового термина - "базисные модели".

Термин "базисные модели" был введен исследователями из Стэнфорда в 2021 г. в статье "О возможностях и рисках базисных моделей" [101]. Предложенный термин помог обозначить смену парадигмы в развитии ИИ и позволил авторам поместить на временной шкале новый период36Возможно, авторы из Стэнфорда преувеличивают значимость предложенного ими нового термина, поставив его в такой ряд. - Примечание научного редактора , который по значимости соседствует с такими глобальными понятиями как "искусственный интеллект" и "машинное обучение". Если ранее мы демонстрировали диаграммы Венна, где глубокое обучение было крайним вложенным элементом (см. рис. 1.14), то теперь внутри последнего вложено еще и множество "базисные модели" (см. рис. 2.33).

При этом авторы упомянутой коллективной статьи подчеркивают, что само понятие "Базисная модель" не является новой технологией, а имеет в своей основе глубокие нейронные сети и самоконтролируемое обучение. И в качестве ярких примеров базисных моделей рассматривают уже упомянутые нами BERT и GPT 3.

Базисные модели вводятся как сверхглубокие мультимодальные нейросетевые модели, которые демонстрируют возникновение новых возможностей на базе технологии глубокого обучения.

Согласно выводам исследователей из Стэнфорда, история ИИ - это история универсализации моделей и развития эмерджентности 37Эмерджентность, свойство, объясняемое связями и законами композиции, которые не наблюдаются у отдельно взятых элементов, но появляются, когда части целого объединены, т. е. при слиянии всех компонентов в определенное структурно-семантическое целое, проявляющейся в этих моделях. Эмерджентность, или спонтанное возникновение38Свойства спонтанно индуцируются, а не конструируются явным образом новых свойств в системе, можно отследить на разных этапах. С внедрением машинного обучения из рассматриваемых данных (из примеров) возникает (автоматически выводится) способ решения задачи; на стадии глубокого обучения возникают высокоуровневые характеристики, используемые для предсказания, а с появлением базисных моделей открываются новые возможности, такие как обучение в контексте.

Говоря об универсализации моделей, можно проследить следующую цепочку. На стадии машинного обучения ( рис. 2.33) для каждой задачи было необходимо извлечение своей совокупности признаков. С появлением базисных моделей можно констатировать, что одна модель может быть базой для широкого круга задач, что, по сути, и знаменует начало эры базисных моделей.

Технологически базисные модели становятся возможными благодаря трансферному обучению и масштабированию. В рамках глубокого обучения преобладающим подходом к трансферному обучению является предварительное обучение: модель обучается на типовой задаче со стандартным датасетом (часто просто как средство достижения цели), а затем адаптируется к последующей задаче, представляющей интерес, путем тонкой настройки.

Более того, современные модели, такие как GPT-3, могут использоваться для решения задач вообще без дополнительного обучения (zero-shot learning) или с крайне небольшим количеством примеров (few-shot learning). Например, мы можем решать задачи текстовой классификации, подавая генеративной модели на вход исходный текст и далее "спрашивая" ее, к какой категории этот текст принадлежит. Это является сменой парадигмы, когда модели становятся настолько большими и дорогими в обучении, что их практически невозможно дообучить в условиях небольшой компании.

Масштабирование достигается на базе совершенствования компьютерного оборудования (например, на базе использования GPU); использование архитектуры модели Transformer, которая позволяет использовать параллелизм аппаратного обеспечения, и обеспечивает доступность гораздо большего количества обучающих данных.

До 2019 года самоконтролируемое обучение с помощью языковых моделей было, по сути, подотраслью NLP, которая развивалась параллельно с другими разработками в NLP. После 2019 года самоконтролируемое обучение с использованием языковых моделей стало скорее основой NLP, поскольку использование BERT стало нормой. Признание того, что одна модель может быть базой для такого широкого круга задач, ознаменовало начало эры базисных моделей. Базисные модели привели к высокому уровню универсализации в том плане, что почти все современные модели NLP теперь адаптированы на основе одной из нескольких базовых моделей, таких как BERT, RoBERTa, BART и др.

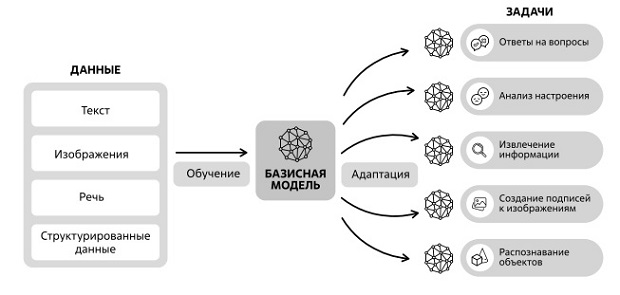

Появление эры базисных моделей проявилось также в универсализации и большей однородности исследовательского инструментария. Аналогичные подходы к моделированию последовательностей на основе трансформеров стали применяться к тексту, изображениям, к речи, табличным данным, к исследованиям органических молекул и т.п. Эти примеры указывают на возможность появления унифицированного набора инструментов для разработки базисных моделей в широком диапазоне модальностей (рис. 2.34).

Рис. 2.34. Базисная модель может быть натренирована на мульти-модальных данных. Источник: Stanford University

Базисная модель может извлекать информацию из данных, различных модальностей, и одна модель может быть адаптирована к широкому спектру решаемых задач.

Это можно назвать изменением парадигмы, поскольку в прошлом считалось, что ИИ-модели способны выполнять одну задачу за раз. Исследование задач разных модальностей, таких как задачи компьютерногозренияизадачиобработкиестественногоязыка,проводилось с использованием разных технических подходов - исследователи зрения изучали такие темы, как обработка сигналов, а исследователи языка - грамматику языка. Сам термин узкий искусственный интеллект в учебниках 5-7-летней давности подавался как интеллект, заточенный на решение одной конкретной задачи и не имеющий возможности решать задачи из других областей, что противопоставлялась возможностям человека учиться в разных направлениях. Даже при наличии концепции трансферного обучения не предполагалось, что одна модель будет выполнять задачи, сильно отличающиеся друг от друга. Базисные модели с глубоким обучением позволили создавать модели, способные выполнять множество задач [103].

На рис2.30, 2.32 был упомянут ряд значимых моделей, появившихся сравнительно недавно. Но технологии развиваются так стремительно, что многие из последних и уже нашумевших проектов в книгу не попали, поскольку заявили о себе буквально за время ее написания. В итоге такие современные модели, как DALLE-2, Midjourney, LAMBDA, Gato и некоторые другие, просто не успели попасть в обзор. Однако мы не могли не отметить чат-бот ChatGPT, специализирующийся на диалогах, который был запущен компанией OpenAI 30 ноября 2022 года и который стал, наверное, самым обсуждаемым проектом в конце 2022 г., как раз на момент завершения работы над курсом.

ChatGPT получен на основе доработки базовой модели от OpenAI GPT-4.5 (улучшенной версии GPT-3). Сервис способен понимать человеческую речь, выстраивать диалог с собеседником, отвечать на сложные вопросы.

Мы попросили чат-бот рассказать о себе. В ответ на запрос "Напиши раздел про GPTChat для книги "Искусственный интеллект. Анализ, тренды, мировой опыт"" от бота был получен следующий ответ. "GPT (Generative Pre-training Transformer) Chat - это большая языковая модель, разработанная OpenAI, которая используется для генерации текста в режиме реального времени. Она была создана для того, чтобы обеспечить натуральную и убедительную коммуникацию с людьми через чат-бот. GPT Chat использует архитектуру Transformer, которая позволяет ей учитывать контекст и понимать смысл текста. Она также имеет доступ к большому корпусу текста, что помогает ей лучше отвечать на различные вопросы и учитывать разные тональности и настроения. GPT Chat уже используется в различных областях, таких как клиентская поддержка, маркетинг, образование и развлечения".

В своем обзоре развития ИИ-систем мы, по сути, подошли к переднему краю разработок, и можно сказать, что определенную (упрощенную и далеко не полную) траекторию эволюции технологий ИИ (по состоянию на конец 2022 г.) представили. В название лекции было вынесено не только слово "развитие", но и слово "структура" технологий ИИ, поэтому далее поговорим о структуре и иерархии ИИ-технологий в составе комплексных решений.

![Базисные модели как ступень эволюции нейросетей. Источник: Stanford University [102]](/EDI/18_12_24_2/1734474022-28631/tutorial/963/objects/2/files/02-33.jpg)