|

Раньше это можно было зделать просто нажав на тест и посмотреть результаты а сейчас никак |

Трассировка логической структуры нейросети

11.3. Оптимальное закрепление рецепторов за событиями в нейросети заданной структуры

Если задана структура нейросети (подразумевается ее "овеществленная" проекция на плоскость

или даже реализация на плате, на кристалле, на решетке связанных процессорных элементов и т.д.), то от распределения рецепторов между событиями зависит возможность формирования отдельных термов без введения дополнительных связей. Например,

если достоверность событий Х1 и Х7 подается на входы, значительно отстающие друг от друга, то при заданной, например, регулярной

структуре связей могут возникнуть большие трудности в реализации аналога конъюнкции  , используемой далее в качестве отдельного

терма, который входит в состав других логических конструкций. Необходимое объединение этих событий на входе одного нейрона может быть

достигнуто даже не ранее, чем на выходном слое. Это потребует введения дополнительных связей для построения необходимого терма.

, используемой далее в качестве отдельного

терма, который входит в состав других логических конструкций. Необходимое объединение этих событий на входе одного нейрона может быть

достигнуто даже не ранее, чем на выходном слое. Это потребует введения дополнительных связей для построения необходимого терма.

Чтобы минимизировать число вводимых дополнительных связей или исключить их вовсе, необходимо на основе анализа конструкций, входящих в состав описания вида (11.1), построить предпочтительный ряд следования событий, реализующий компромисс в выборе минимальных расстояний между элементами этого ряда.

Пусть на рис. 11.2 представлена структура нейросети, которую следует обучить в соответствии с логическим описанием (11.1) создаваемой СПР. На рисунке отображено окончательное решение задачи трассировки, и связи с единичными весами выделены. Произведем обоснование этого решения и, прежде всего, распределим события между нейронами- рецепторами.

Воспользуемся следующим алгоритмом упорядочения событий.

- Организуем сквозной просмотр всех выражений (11.1) и выпишем последовательность имен событий в порядке их обнаружения.

- Просматриваем слева направо сформированную последовательность и находим имя события, входящего в эту последовательность неоднократно.

- Находим среднее значение позиций, занимаемых именем найденного события в последовательности, и определяем для него ближайшее целое, не меньшее найденного.

- Найденное значение определяет новый порядковый номер данного события в последовательности. Заносим имя события на новую позицию и исключаем другие его вхождения в последовательность.

- Шаги 2-4 повторяем до достижения единственности вхождения всех имен событий в последовательность.

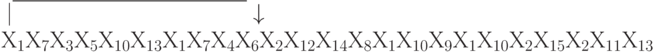

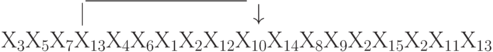

В рассматриваемом примере последовательность имен событий первоначально имеет вид

Имя Х1 входит неоднократно. Новая его позиция определяется как ](1 + 7 + 15 + 18) : 4[ = 11. После переноса Х1 на новое место (показано стрелкой) и исключения его прежних вхождений последовательность имен принимает вид

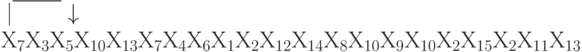

Новое место Х7 определяется как ](1 + 6) : 2[ = 4. Последовательность принимает вид

Новое место Х10 определяется как ](3 + 13 + 15) : 3[ = 11. Последовательность принимает вид

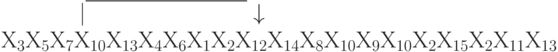

Новая позиция Х13 определяется как ](4 + 18) : 2[ =11. Получаем новый вид последовательности:

Отыскивается новое место Х2, как ](7 + 14 + 16) : 3[ = 13, и последовательность имен событий принимает окончательный вид, отображенный на рисунке:

Заметим, что при реализации на компьютере "кнопки" или окна на панели управления могут располагаться в удобном для пользователя порядке, соединяясь с закрепленными за ними рецепторами.