|

Не могу найти требования по оформлению выпускной контрольной работы по курсу профессиональной переподготовки "Менеджмент предприятия" |

Многомерный статистический анализ

Основы линейного регрессионного анализа

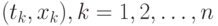

В предыдущем пункте метод наименьших квадратов описан в простейшем случае. Он допускает различные обобщения. Например, метод наименьших квадратов дает алгоритм расчетов в случае, если исходные данные - по-прежнему набор n пар чисел  , где

, где  - независимая переменная (например, время), а

- независимая переменная (например, время), а  - зависимая (например, индекс инфляции - см.

"Эконометрический анализ инфляции"

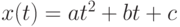

), а восстанавливать надо не линейную зависимость, а квадратическую:

- зависимая (например, индекс инфляции - см.

"Эконометрический анализ инфляции"

), а восстанавливать надо не линейную зависимость, а квадратическую:

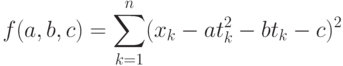

Следует рассмотреть функцию трех переменных

Оценки метода наименьших квадратов - это такие значения параметров  и

и  , при которых функция

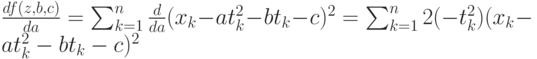

, при которых функция  достигает минимума по всем значениям аргументов. Чтобы найти эти оценки, надо вычислить частные производные от функции

достигает минимума по всем значениям аргументов. Чтобы найти эти оценки, надо вычислить частные производные от функции  по аргументам

по аргументам  ,

,  и

и  , приравнять их 0, затем из полученных уравнений найти оценки: Имеем:

, приравнять их 0, затем из полученных уравнений найти оценки: Имеем:

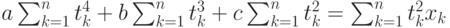

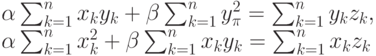

Приравнивая частную производную к 0, получаем линейное уравнение относительно трех неизвестных параметров  :

:

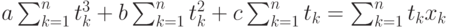

Приравнивая частную производную по параметру  к 0, аналогичным образом получаем уравнение

к 0, аналогичным образом получаем уравнение

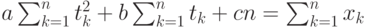

Наконец, приравнивая частную производную по параметру с к 0, получаем уравнение

Решая систему трех уравнений с тремя неизвестными, находим оценки метода наименьших квадратов.

Другие задачи, рассмотренные в предыдущем пункте (доверительные границы для параметров и прогностической функции и др.), также могут быть решены. Соответствующие алгоритмы более громоздки. Для их записи полезен аппарат матричной алгебры (см., например, одну из лучших в этой области монографий [2]). Для реальных расчетов используют соответствующие компьютерные программы.

Раздел многомерного статистического анализа, посвященный восстановлению зависимостей, называется регрессионным анализом. Термин "линейный регрессионный анализ" используют, когда рассматриваемая функция линейно зависит от оцениваемых параметров (от независимых переменных зависимость может быть произвольной). Теория оценивания неизвестных параметров хорошо развита именно в случае линейного регрессионного анализа. Если же линейности нет и нельзя перейти к линейной задаче, то, как правило, хороших свойств от оценок ожидать не приходится.

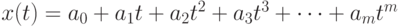

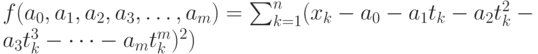

Продемонстрируем подходы в случае зависимостей различного вида. Если зависимость имеет вид многочлена (полинома)

то коэффициенты многочлена могут быть найдены путем минимизации функции

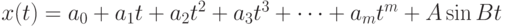

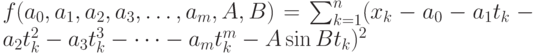

Функция от  не обязательно должна быть многочленом. Можно, например, добавить периодическую составляющую, соответствующую сезонным колебаниям. Хорошо известно, например, что инфляция (рост потребительских цен) имеет четко выраженный годовой цикл - в среднем цены быстрее всего растут зимой, в декабре - январе, а медленнее всего (иногда в среднем даже падают) летом, в июле - августе. Пусть для определенности

не обязательно должна быть многочленом. Можно, например, добавить периодическую составляющую, соответствующую сезонным колебаниям. Хорошо известно, например, что инфляция (рост потребительских цен) имеет четко выраженный годовой цикл - в среднем цены быстрее всего растут зимой, в декабре - январе, а медленнее всего (иногда в среднем даже падают) летом, в июле - августе. Пусть для определенности

тогда неизвестные параметры могут быть найдены путем минимизации функции

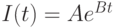

Пусть  -индекс инфляции в момент t. Принцип стабильности условий приводит к гипотезе о постоянстве темпов роста средних цен, т.е. индекса инфляции. Таким образом, естественная модель для индекса инфляции - это

-индекс инфляции в момент t. Принцип стабильности условий приводит к гипотезе о постоянстве темпов роста средних цен, т.е. индекса инфляции. Таким образом, естественная модель для индекса инфляции - это

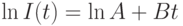

Эта модель не является линейной, метод наименьших квадратов непосредственно применять нельзя. Однако если прологарифмировать обе части предыдущего равенства:

то получим линейную зависимость, рассмотренную в первом пункте настоящей лекции.

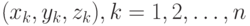

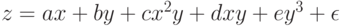

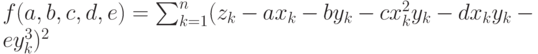

Независимых переменных может быть не одна, а несколько. Пусть, например, по исходным данным  требуется оценить неизвестные параметры

требуется оценить неизвестные параметры  и

и  в зависимости

в зависимости

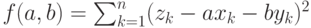

где  - погрешность. Это можно сделать, минимизировав функцию

- погрешность. Это можно сделать, минимизировав функцию

Зависимость от  и

и  не обязательно должна быть линейной. Предположим, что из каких-то соображений известно, что зависимость должна иметь вид

не обязательно должна быть линейной. Предположим, что из каких-то соображений известно, что зависимость должна иметь вид

тогда для оценки пяти параметров необходимо минимизировать функцию

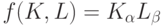

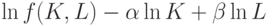

Более подробно рассмотрим пример из микроэкономики. В одной из оптимизационных моделей поведения фирмы используется т.н. производственная функция  , задающая объем выпуска в зависимости от затрат капитала

, задающая объем выпуска в зависимости от затрат капитала  и труда

и труда  . В качестве конкретного вида производственной функции часто используется так называемая функция Кобба-Дугласа

. В качестве конкретного вида производственной функции часто используется так называемая функция Кобба-Дугласа

Однако откуда взять значения параметров  и

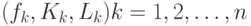

и  ? Естественно предположить, что они - одни и те же для предприятий отрасли. Поэтому целесообразно собрать информацию

? Естественно предположить, что они - одни и те же для предприятий отрасли. Поэтому целесообразно собрать информацию  где

где  - объем выпуска на

- объем выпуска на  -ом предприятии,

-ом предприятии,  - объем затрат капитала на

- объем затрат капитала на  -ом предприятии,

-ом предприятии,  - объем затрат труда на

- объем затрат труда на  -ом предприятии (в кратком изложении здесь не пытаемся дать точных определений используемым понятиям из экономики предприятия). По собранной информации естественно попытаться оценить параметры

-ом предприятии (в кратком изложении здесь не пытаемся дать точных определений используемым понятиям из экономики предприятия). По собранной информации естественно попытаться оценить параметры  и

и  . Но они входят в зависимость нелинейно, поэтому сразу применить метод наименьших квадратов нельзя. Помогает логарифмирование:

. Но они входят в зависимость нелинейно, поэтому сразу применить метод наименьших квадратов нельзя. Помогает логарифмирование:

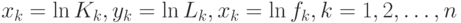

Следовательно, целесообразно сделать замену переменных

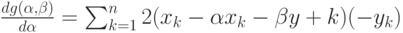

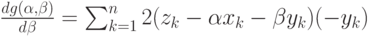

а затем находить оценки параметров  и

и  , минимизируя функцию

, минимизируя функцию

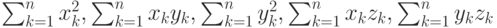

Приравняем частные производные к 0, сократим на 2, раскроем скобки, перенесем свободные члены вправо. Получим систему двух линейных уравнений с двумя неизвестными:

Таким образом, для вычисления оценок метода наименьших квадратов необходимо найти пять сумм

Для упорядочения расчета этих сумм может быть использована таблица типа той, что применялась в первом пункте настоящей лекции. Отметим, что рассмотренная там постановка переходит в разбираемую сейчас при