Вопросы безопасности и этики применения ИИ

Люди захотят усовершенствовать свои ментальные возможности: улучшить память сверх того, что сегодня считается биологической нормой, увеличить реакцию, получить новые способности по восприятию и обработке информации.

Перспективы появления данной технологии порождают вопросы из области этики. Кому в первую очередь будут доступны подобные усовершенствования? Не вызовут ли подобные усовершенствования интеллектуальный разрыв между богатыми и бедными? Смогут ли люди без чипов претендовать на престижную работу, не лишат ли подобные усовершенствования человека человечности?

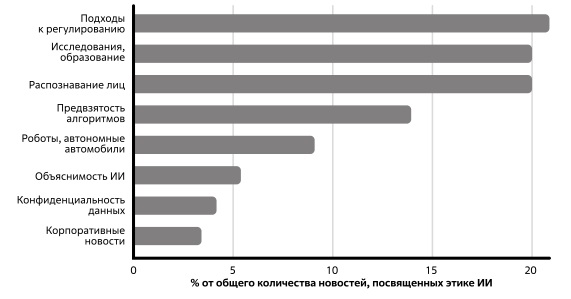

Внимание к вопросам соблюдения вопросов этики в области ИИ растет. На рис. 4.13 по данным AI-Index-Report 2021 представлена статистика, отражающая темы новостных публикаций в СМИ, в которых наиболее часто обсуждается вопрос соблюдения этики в ИИ [252].

Рис. 4.13. Темы новостных публикаций, в которых наиболее часто обсуждается вопрос соблюдения этики в ИИ. Источник: AI-Index-Report 2021

Статистика была построена на базе анализа 60 тысяч англоязычных новостных источников и более 500 тыс. блогов в 2020 году. Материалы были сгруппированы в семь тем на основе языкового сходства. Статьи, касающиеся этических рекомендаций и рамок ИИ, возглавили список наиболее освещаемых новостных тем (21%), за ними следуют "исследования и образование" (20%) и "распознавание лиц" (20%).

Из ИИ-технологий, которые наиболее часто приводят к озабоченности, - это именно использование распознавания лица и ошибки, связанные с использованием данной практики. Известны случаи, когда людей арестовывали по ложному совпадению при ошибках распознавания лиц.

В профессиональной литературе обсуждается большое число проблем, которые связывают с разработкой этичного ИИ. Попытку классификации данных проблем можно найти в книге одного из исследователей ИИ Bernd Carsten Stahl (см. табл.4.1).Согласно этой классификации, существует три категории проблем: первые связаны с природой методов машинного обучения, вторые - возникают перед человеком, который вынужден жить в формирующемся "цифровом мире", и третьи - это метафизические экзистенциальные проблемы, связанные с попыткой осмысления перспектив жизни человека и его роли в мире, в котором ИИ будет приобретать все больше автономности.

| 1. Проблемы, возникающие при машинном обучении | |

| Конфиденциальность и защита данных |

Отсутствие конфиденциальности Неправомерное использование персональных данных Проблемы, связанные с безопасностью |

| Надежность |

Отсутствие качественных данных Недостаточная точность данных Проблемы целостности данных |

| Прозрачность |

Отсутствие подотчетности и ответственности Отсутствие прозрачности Предвзятость и дискриминация Недостаточная точность прогностических рекомендаций Недостаточная точность неиндивидуальных рекомендаций |

| Безопасность | Нанесение вреда физической целостности систем |

| 2. Жизнь в цифровом мире | |

| Экономические проблемы |

Исчезновение рабочих мест Концентрация экономической власти Высокая стоимость инноваций |

| Правосудие и справедливость |

Оспаривание права собственности на данные Негативное влияние на систему правосудия Отсутствие доступа к государственным услугам Нарушение основных прав человека конечных пользователей Нарушение основных прав человека в цепочке поставок Негативное воздействие на уязвимые группы населения Несправедливость |

| Свобода |

Отсутствие свободы доступа к информации Потеря возможности принятия решений человеком Потеря свободы и индивидуальной автономии |

| Более широкие общественные проблемы |

Неравные отношения со стороны власти Асимметрия власти Негативное влияние на демократию Проблемы контроля и использования данных и систем Отсутствие информированного согласия Отсутствие доверия Потенциал военного использования Негативное воздействие на здоровье Сокращение контактов с людьми Негативное воздействие на окружающую среду |

| Проблемы неопределенности |

Непреднамеренные, непредсказуемые негативные последствия Приоритет "неправильных" проблем Потенциал преступного и злонамеренного использования |

| 3. Метафизические вопросы | |

| Метафизические вопросы |

Машинное сознание "Пробуждение" искусственного интеллекта Автономные моральные агенты Сверхинтеллект Сингулярность Изменения в природе человека |

Поскольку ИИ стал неотъемлемой частью продуктов и услуг, организации начинают разрабатывать этические кодексы ИИ - руководства к действию при выработке этичных решений относительно использования искусственного интеллекта.

Разработка этики ИИ имеет решающее значение для помощи законодателям в создании справедливой политики и законов, а также для руководства работой ученых и исследователей. Оно помогает соблюдать требования, принимать решения о целесообразном финансировании, делать выводы о том, как применять ИИ в своих продуктах и услугах.

Таблица 4.1 наглядно иллюстрирует, как много направлений в трактовке этических проблем в области ИИ и как трудно их иллюстрировать в виде краткой диаграммы. Подобную задачу ставили разные исследователи. В частности, авторы работы под названием "Mapping Consensus in Ethical and Rights-Based Approaches to Principles for AI" изучили 36 основных документов о принципах формирования этичного ИИ, почерпнув информацию из различных типов организаций, чтобы найти в них общие темы и ценности, и попытались свести многочисленные публикации к краткому набору общепринятых принципов в виде простой наглядной диаграммы (рис. 4.14).

Основные принципы не требуют пояснения, за исключением, возможно, принципа "подотчетности", который подразумевает, что сторона, которая выполняет какие-либо действия в отношении клиентов, должна их информировать о том, что именно провайдер делает в отношении этих данных, и о причинах, по которым он это делает.

Вопрос о вероятности сценария, согласно которому развитие машин, оснащенных ИИ, на некотором этапе представит прямую угрозу самого существования человека, одна из самых обсуждаемых тем, связанных с ИИ. Специалисты, которые хотят преуменьшить серьезность проблемы, часто сводят подобное обсуждение к упрощенному вопросу "почему невозможно восстание машин", описанное в фантастических фильмах. Однако негативные последствия для человека, связанные с развитием искусственного интеллекта, могут иметь менее зрелищные, чем голливудские, но не менее опасные формы. Неслучайно лучшие умы из числа специалистов, работавших в данной области, отмечали опасное воздействие ИИ на жизнь человека.

Так, например, комментируя вопрос журналиста "существует ли опасность, что вычислительные машины - когда-нибудь возьмут верх над людьми", Норберт Винер говорил, что если человек когда-то передаст вопрос о способе употребления машин самим этим машинам, то он сам таким образом "напрашивается на неприятность…". А комментируя вопрос, не изменяет ли человек окружающую среду свыше своих способностей приспосабливаться к ней, Винер говорил, что человек этого, возможно, не узнает, поскольку его просто не будет [255].

![Ключевые вопросы при выработке этичного ИИ. Источник: Harward University [254]](/EDI/18_12_24_2/1734474022-28631/tutorial/963/objects/4/files/04-14.jpg)